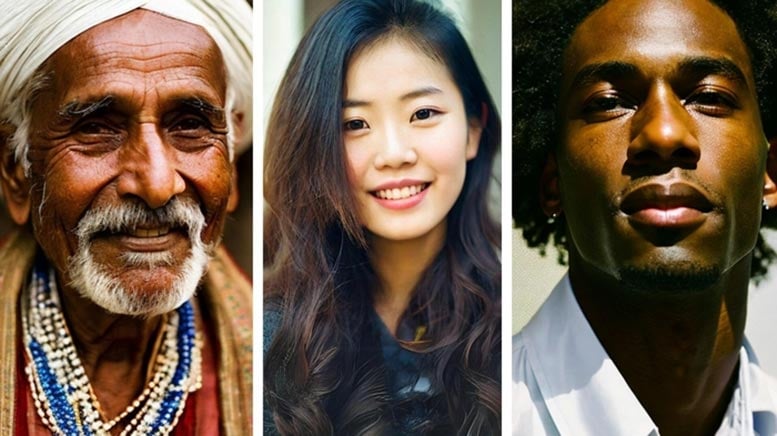

מחקר של אוניברסיטת ווטרלו מצא שאנשים נאבקים להבדיל בין תמונות אמיתיות לתמונות שנוצרו בינה מלאכותית, עם דיוק של 61% בלבד, מה שמעורר חששות לגבי מהימנות המידע החזותי והצורך בכלים לזיהוי תוכן שנוצר בינה מלאכותית. קרדיט: twoday.co.il.com

מחקרים מראים שהמשתתפים בסקר הוטעו על ידי תמונות שנוצרו בינה מלאכותית כמעט 40 אחוז מהמקרים.

אם לאחרונה התקשיתם להבין אם תמונה של אדם אמיתית או נוצרת באמצעות בינה מלאכותית (AI), אתם לא לבד.

מחקר חדש מ אוניברסיטת ווטרלו חוקרים גילו שאנשים התקשו יותר מהצפוי להבחין מיהו אדם אמיתי ומי נוצר באופן מלאכותי.

מחקר ווטרלו ראה 260 משתתפים שסופקו עם 20 תמונות ללא תווית: 10 מהן היו של אנשים אמיתיים שהתקבלו מחיפושים בגוגל, וה-10 האחרות נוצרו על ידי Stable Diffusion או DALL-E, שתי תוכניות AI נפוצות שמייצרות תמונות.

המשתתפים התבקשו לתייג כל תמונה כאמיתית או שנוצרה בינה מלאכותית ולהסביר מדוע קיבלו את החלטתם. רק 61 אחוז מהמשתתפים יכלו להבחין בהבדל בין אנשים שנוצרו בינה מלאכותית לבין אנשים אמיתיים, הרבה מתחת לסף של 85 אחוזים לו ציפו החוקרים.

שלוש מהתמונות שנוצרו על ידי AI בשימוש במחקר. קרדיט: אוניברסיטת ווטרלו

אינדיקטורים מטעים ופיתוח AI מהיר

"אנשים לא מיומנים לעשות את ההבחנה כפי שהם חושבים שהם", אמרה אנדריאה פוקול, מועמדת לדוקטורט במדעי המחשב באוניברסיטת ווטרלו והמחברת הראשית של המחקר.

המשתתפים שמו לב לפרטים כמו אצבעות, שיניים ועיניים כאינדיקטורים אפשריים כאשר חיפשו תוכן שנוצר בינה מלאכותית – אך ההערכות שלהם לא תמיד היו נכונות.

Pocol ציין כי אופי המחקר איפשר למשתתפים לבחון את התמונות ארוכות, בעוד שרוב משתמשי האינטרנט מסתכלים על תמונות בדרך אגב.

"אנשים שפשוט גוללים דין או שאין להם זמן לא יקבלו את הרמזים האלה", אמר פוקול.

Pocol הוסיף כי הקצב המהיר ביותר שבו מתפתחת טכנולוגיית בינה מלאכותית מקשה במיוחד על הבנת הפוטנציאל לפעולה זדונית או מרושעת הנובעת מתמונות שנוצרו על ידי בינה מלאכותית. קצב המחקר והחקיקה האקדמיים לא מצליחים לעתים קרובות לעמוד בקצב: תמונות שנוצרו על ידי בינה מלאכותית הפכו מציאותיות עוד יותר מאז שהמחקר החל בסוף 2022.

האיום של דיסאינפורמציה שנוצרת על ידי בינה מלאכותית

תמונות אלה שנוצרות בינה מלאכותית מאיימות במיוחד ככלי פוליטי ותרבותי, שעלול לראות כל משתמש יוצר תמונות מזויפות של אישי ציבור במצבים מביכים או מתפשרים.

"דיסאינפורמציה אינה חדשה, אבל הכלים של דיסאינפורמציה השתנו והתפתחו ללא הרף", אמר פוקול. "זה עלול להגיע למצב שבו אנשים, לא משנה כמה הם יהיו מאומנים, עדיין ייאבקו להבדיל בין תמונות אמיתיות לזיופים. לכן אנחנו צריכים לפתח כלים לזהות ולהתמודד עם זה. זה כמו מרוץ חימוש חדש של AI."

המחקר, "לראות אינו מאמין יותר: סקר על מצבם של Deepfakes, בני אדם שנוצרו בינה מלאכותית ואמצעי מדיה לא אמיתיים אחרים", פורסם בכתב העת התקדמות בגרפיקה ממוחשבת.